EU Artificial Intelligence Act

Az Európai Unió átfogó szabályozása a mesterséges intelligencia használatára

| Teljes név | EU Artificial Intelligence Act (AI Act) |

| Elfogadva | 2024. május – Európa Tanács |

| Hatályba lépés | Fokozatosan 2024. augusztus 1-től |

| Kit érint | Minden céget, aki AI-t használ vagy fejleszt az EU-ban – beleértve az EU-n kívüli cégeket is, ha rendszereiket az EU-ban alkalmazzák. |

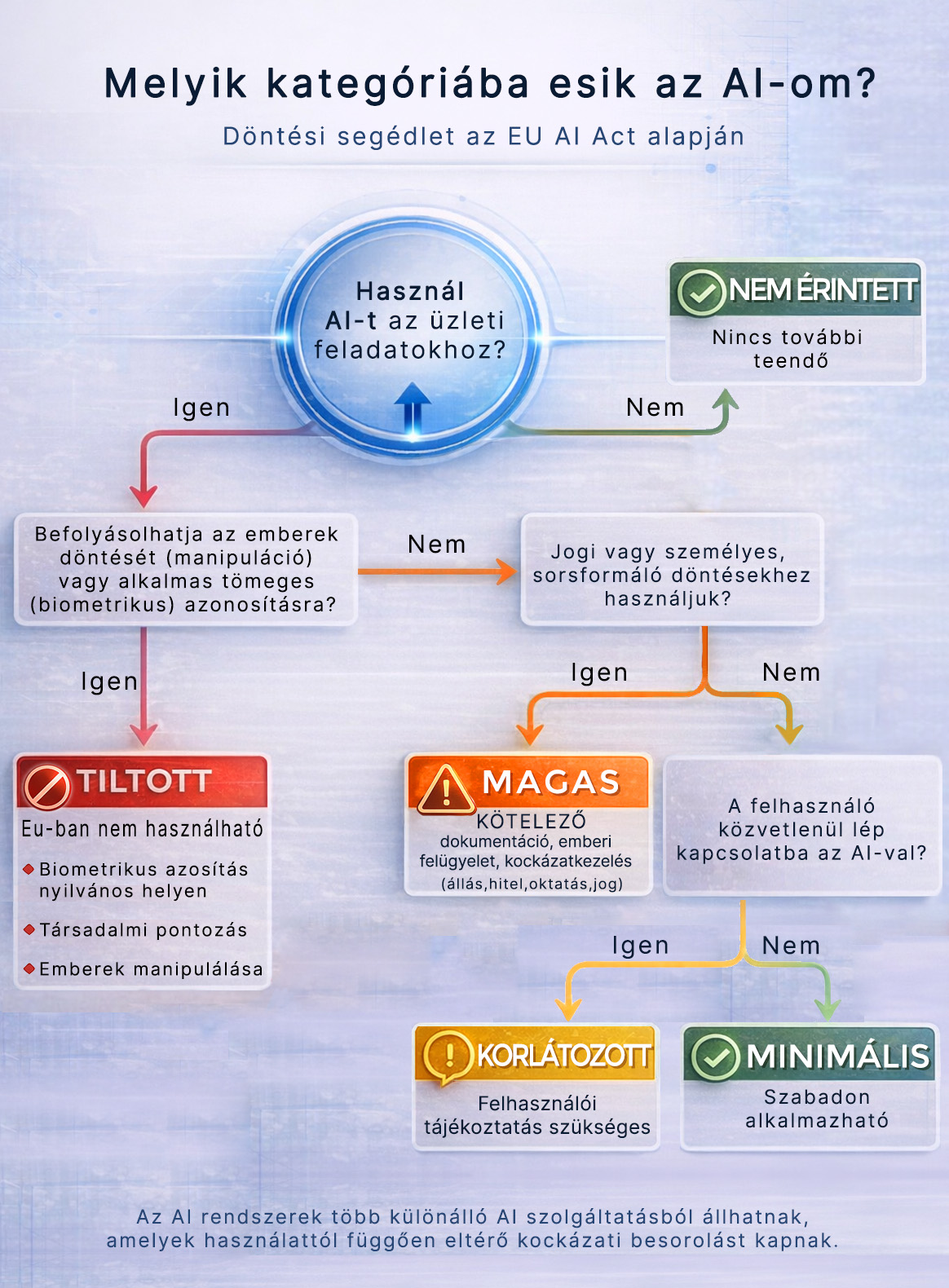

Az AI Act az első átfogó, kötelező erejű AI szabályozás, a GDPR-hoz hasonló logikai alapokon. Célja, hogy a mesterséges intelligencia használatát biztonságossá és etikussá tegye az EU-ban. A megközelítés kockázat alapú: minél veszélyesebb kategóriába sorolják a használatot, annál több szabály vonatkozik rá. Ugyanaz a GPAI vagy Foundation modell többféle szolgáltatást is biztosíthat – ezek besorolása használat szerint eltérő lehet.

| ℹ Mellékletek A rendelet XI, XII, XIII. melléklete a műszaki dokumentációra, az átláthatóságra és a megjelölésre vonatkozó konkrét kritériumokat határozza meg. |

A bevezetés fokozatos – fontosabb határidők

| 2025. február 2. | Elfogadhatatlan kockázatú rendszerek betiltása (6 hónap) |

| 2025. augusztus 2. | General Purpose AI szabályok (12 hónap) |

| 2027. augusztus 2. | Magas kockázatú rendszerek teljes megfelelés (36 hónap) |

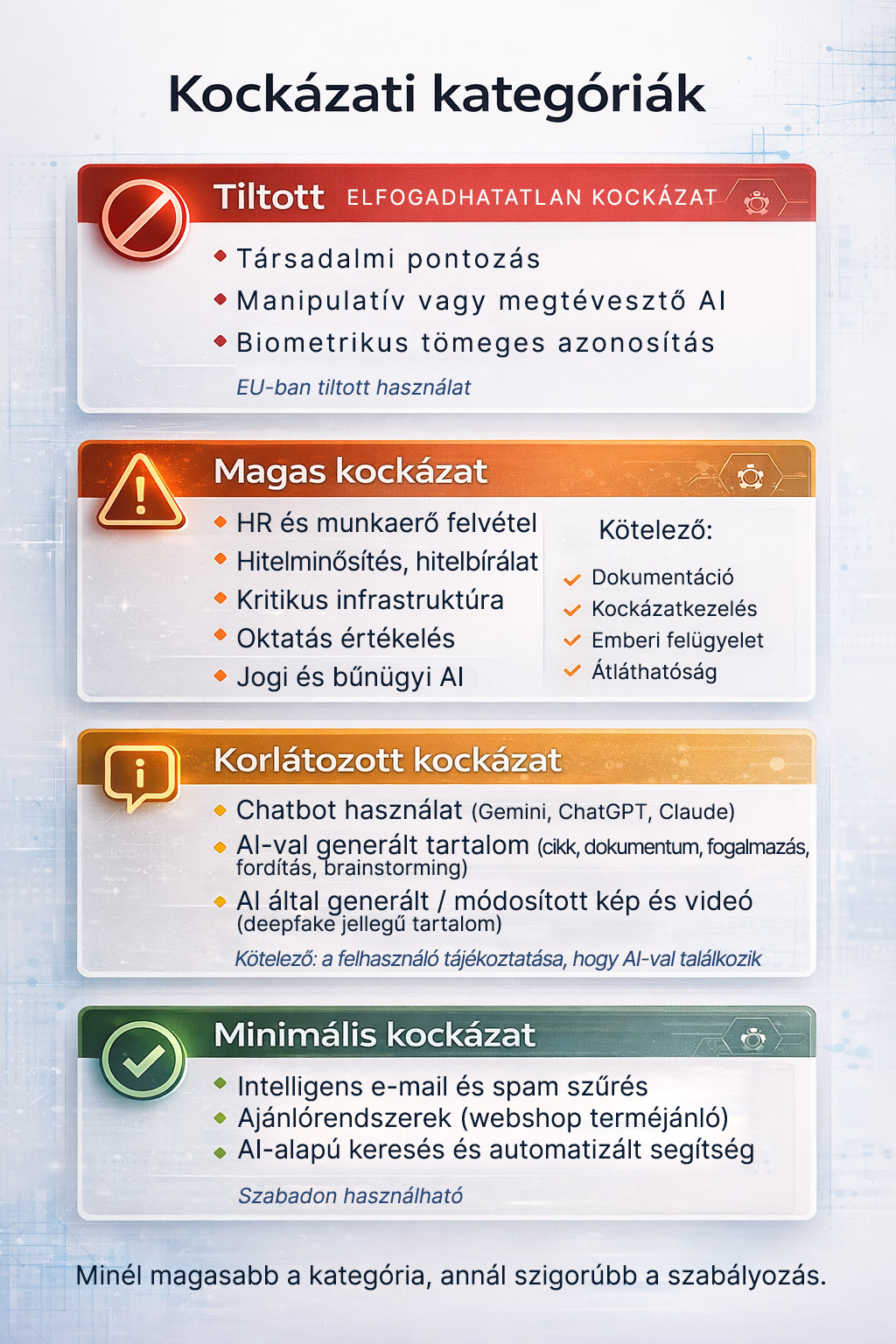

Az AI Act 4 kockázati kategóriája

| 1. ELFOGADHATATLAN KOCKÁZAT → TILTOTT |

- Szociális pontozás (mint Kínában)

- Biometrikus valós idejű megfigyelés köztereken (kivéve pl. rendőrség, biztonság)

- Manipulatív AI – ami kihasználja az emberek sebezhetőségét

| Büntetés: akár €35M vagy a globális forgalom 7%-a |

| 2. MAGAS KOCKÁZAT → SZIGORÚ SZABÁLYOK |

| Magas kockázat esetén célszerű AI Act szakértőt (jogászt) bevonni. |

Jogi, bűnügyi vagy személyes sorsformáló döntésekhez történő igénybevétel esetén.

Érintett területek:

- Munkaerő-felvétel – önéletrajzok automatikus szűrése, jelöltek és interjúk értékelése

- Hitelminősítés, hitelbírálat

- Kritikus infrastruktúra – energia, víz

- Oktatási célok – diákok értékelése

- Jogérvényesítés – bűnügyi AI

Kötelező követelmények:

- Kockázatértékelés: kötelező elvégezni az AI bevezetése előtt és rendszeresen felülvizsgálni.

- Emberi felügyelet: Az embernek értenie kell, mit és miért ajánl az AI, és képesnek kell lennie az AI döntését felülírni, ha az nem elfogadható

- Átláthatóság, dokumentáció: Az AI működésének mindig követhetőnek és visszanézhetőnek kell lennie. A dokumentációnak tartalmaznia kell: mire használják, milyen adatokon tanult, hogyan születik az eredmény és milyen korlátai vannak a rendszer döntésének.

- Adatminőség: A bias* elkerülése. Az adatminőség alapjaiban határozza meg az AI használat kockázatát és annak kezelését. A bias[1] következményeinek (diszkrimináció és veszélyes hibák) elkerülése érdekében a szabályozás reprezentatív, torzításoktól mentes, friss és ellenőrizhető tanítóadatot vár el. A cél nem a nulla bias – ez kivitelezhetetlen –, hanem a megbízhatóbb, tiszta adatokra épülő eredmény, mert a régi vagy félrevezető adatok hibás AI döntést generálhatnak.

- Megfelelőségi értékelés (CE jelöléshez hasonló rendszer): A dokumentáció, kockázatkezelési folyamatok és auditok elvégzésével a gyártó igazolja, hogy az AI rendszer megfelel az EU előírásainak.

| Büntetés: akár €15M vagy a globális forgalom 3%-a |

| 3. KORLÁTOZOTT KOCKÁZAT → ÁTLÁTHATÓSÁGI KÖTELEZETTSÉG |

Ide tartoznak a General Purpose AI-k, a Foundation Modelek és LLM-ek (Gemini, ChatGPT, Claude, Grok), a chatbotok, az AI által generált tartalmak – deepfake, szintetikus szövegek, képek, videók. Az AI generált képek felismerése tapasztalat kérdése: aki maga is dolgozott ilyen eszközökkel, hamar felismeri a jellegzetes stílusjegyeket.

A céges munkaállomások egyes funkciói szintén ide tartoznak: intelligens keresés, automatikus szöveg- vagy kódjavaslat, meeting összefoglalók, dokumentum ajánlások, workflow automatizálás (pl. Copilot-jellegű asszisztensek). Ezek többnyire korlátozott kockázatúak, viszont a felhasználó közvetlenül AI-val találkozik, így → tájékoztatás szükséges.

Konkrét tevékenységek ebben a kategóriában:

- Cikk írás, email fogalmazás, fordítás, brainstorming

- Programozás, dokumentumok ellenőrzése

- Kép generálás (jelezni kell, hogy AI készítette)

- Chatbot alkalmazása (jelezni kell az ügyfélnek)

Kötelező követelmények:

- Jelezni kell, ha egy ügyfélszolgálaton AI-val kommunikál a felhasználó

- Az AI által generált tartalmat meg kell jelölni

| Hogyan kell jelezni? – TRANSPARENCY DISCLOSURE (AI Act compliance) Az AI által generált tartalmaknál kötelező átláthatósági nyilatkozatot mellékelni, amely tartalmazza az igénybe vett AI eszközöket és azok szerepét a tartalomkészítésben. Példa (saját adatokkal kitöltendő): ▸ Háttérkutatás: Claude AI (Anthropic) ▸ Tartalmi ellenőrzés: ChatGPT (OpenAI) ▸ Képgenerálás: Midjourney / DALL-E |

| Büntetés: akár €7,5M vagy a globális forgalom 1,5%-a |

| 4. MINIMÁLIS KOCKÁZAT → NINCS KÖTELEZŐ SZABÁLYOZÁS |

Azok a használatok tartoznak ide, amelyek nem hoznak jogi vagy személyes sorsdöntő döntést, és a felhasználó nem találkozik közvetlenül az AI-val.

Vállalati környezetben jellemző példák:

- Inventory management: Készletigény előrejelzés, rendelések optimalizálása, fogyási minták elemzése, raktár-optimalizálás, kereslet-előrejelzés.

- Spam filterek: AI-alapú e-mail szűrő rendszerek – kéretlen vagy veszélyes levelek felismerése, tartalom- és mintázatelemzés, folyamatos tanulás, automatikus priorizálás.

- IT infrastruktúra eszközök: Anomália-észlelés, ransomware aktivitás felismerése, intelligens backup optimalizálás, logelemzés, automatikus teljesítményhangolás.

Mi hívta életre az AI Act-ot?

Minden új technológia úttörő szakaszában teljesen természetes, hogy annak használhatóságát minél szélesebb körben kipróbálják és tesztelik. Az alkalmazás és tesztelés során több esetben olyan anomáliák jelentek meg, amelyek kérdésessé tették a további alkalmazást a kritikus területeken.

1. Amazon HR AI (2018)

Az Amazon mérnökök olyan AI-t akartak fejleszteni, amely megtalálja a legjobb jelölteket az adott pozíciókra. Tréningadatként a múltbeli, sikeres Amazon alkalmazottak önéletrajzait használták.

Mivel a korábbi sikeres alkalmazottak 90%-a férfi volt az Amazonnál, itt lépett be a bias, melynek eredményeként az AI azt tanulta meg, hogy a férfi jelölt jobb. Ennek következtében kizárta vagy lejjebb sorolta azokat az önéletrajzokat, amelyek női egyetemekhez kapcsolódtak, mivel a "women's" szót negatívan értékelte bizonyos kontextusokban. Az anomáliát a HR osztály vette észre tesztelés közben – a projektet törölték.

Forrás: Reuters oknyomozó riportja [1]

2. COMPAS – bűnügyi AI, USA (2016)

Az egyik legismertebb példa arra, amikor az adatbias eltorzítja az algoritmikus döntéstámogatást. Ez is iskolapéldája a magas kockázatú AI használatnak.

A COMPAS rendszer azt jelzi előre, hogy egy elítélt mekkora eséllyel fog újra bűnt elkövetni. A betanítást az Equivant nevű magáncég végezte múltbeli bűnügyi adatokkal. A tréningadatok statisztikailag eleve diszkriminatívak voltak – a rendőrség aránytalanul többet ellenőriz fekete személyeket, és a letartóztatások száma is magasabb körükben. Ennek következtében az AI a fekete elítélteknél a reálisnál magasabb, a fehér elítélteknél a reálisnál alacsonyabb visszaesési kockázatot becsült.

A biast a ProPublica3 bizonyította be 2016-ban, az Equivant tagadta. Az ügy perré alakult. A Wisconsini Legfelsőbb Bíróság4 kimondta, hogy a COMPAS használható bírói döntések támogatására, de csak korlátozásokkal és óvatossággal, hangsúlyozva, hogy az AI csupán segédeszköz, nem döntéshozó. Ugyanakkor a rendelkezésre álló adatok alapján a bíróság nem írt elő adattisztítást, bias-auditot vagy fairness validációt.

Forrás: ProPublica [2] | Wisconsin Supreme Court [3] | Harvard Law Review [4] | Fairness Validation [5]

[1]Reuters oknyomozó riportja (2018): Amazon scraps secret AI recruiting tool

[2]ProPublica (2016): How We Analyzed the COMPAS Recidivism Algorithm

[3]Wisconsin Supreme Court – State v. Loomis: SCOW upholds use of COMPAS at sentencing

[4]Harvard Law Review – State v. Loomis: harvardlawreview.org

[5]Fairness Validation: Annak ellenőrzése, hogy az AI nem kezel-e bizonyos csoportokat indokolatlanul hátrányosan, nem hoz-e rendszeresen eltérő eredményt hasonló helyzetekben, nem örökíti-e tovább a múltbeli torzításokat.

Ez az eset az EU AI Act szabályozásának nyers prototípusa. Jogi és etikai szempontból talán az egyik legkomplexebb és legizgalmasabb kérdés az AI használat során: alkalmazható-e egy algoritmus jogi vagy személyes döntésekre, ha működésének és betanításának részletei nem ellenőrizhetők?

3. AI alapú arcfelismerés (Facial recognition)

Ismét egy klasszikus példája az adatbiasnak – emellett technikailag is a legösszetettebb, legnehezebb feladat, ahol a hibalehetőség hatványozottan megjelenhet.

Az arcfelismerő AI-ok betanítását tech multicégek végzik, mint a Google, Amazon, Microsoft. Ha a tréningadat nem egyenletes demográfiai eloszlású és bizonyos arctípusokat felülreprezentál, akkor ennek következtében egyes arcstruktúrákat a rendszer jobban felismer, másokat pontatlanul vagy instabilan. Az AI a gyakori vagy esztétikailag kedvezőbb mintákat preferálja – ezért az arcfelismerés pontossága jelentősen függ a tréningadat minőségétől és reprezentativitásától. Finom arányeltolódások, ritkább arctípusok gyengébb felismerése vagy szemek és arcvonások torzítása mind megjelenhetnek az eredményben.

Az adatbias releváns kockázatai:

- Hibás azonosítás (false positive): Valakit tévesen azonosít.

- Pontosságkülönbség csoportok között: Bizonyos demográfiai csoportoknál sokkal rosszabb a teljesítmény.

| MIT Media Lab – Gender Shades (2018) ▸ Világos bőrű férfi arcok: 0,8% hibaarány (99%-os pontosság) ▸ Sötétebb bőrű nők: 34,7% hibaarány (65%-os pontosság) A rendszer torzítása következtében sötétebb bőrű személyeket többször tartóztattak le tévesen, mivel az AI rosszul azonosította őket. Forrás: Joy Buolamwini & Timnit Gebru (MIT Media Lab) [1] |

Ennek hatására az Amazon, Microsoft, IBM 2020-ban felfüggesztette a facial recognition értékesítését a hatóságoknak. Más, kisebb cégek azonban még mindig árusítják ezeket az algoritmusokat.

| És itt fontos hangsúlyozni: Nem az algoritmus a hibás, hanem a tréningadatok. |

[1]Joy Buolamwini & Timnit Gebru (MIT Media Lab) – Gender Shades (2018): proceedings.mlr.press

Miért különösen nehéz az arcfelismerés technikailag?

Az arcfelismerés szemből – ami a legtöbb rendszer alapbeállítása – technikailag nem triviális feladat. Az AI nem "látja" az arcot úgy, ahogy mi: statisztikai hasonlóság alapján valószínűséget becsül.

Szemből történő felismerés nehézségei:

- Mélységi információ hiánya: Az arc 3D struktúrája nagyrészt 2D projekcióvá lapul – az orr, járomcsont, áll mélysége kevésbé kivehetően jelenik meg.

- Túl erős szimmetria: Az arc szimmetriája miatt kevesebb egyedi formai eltérés mutatkozik. Az AI számára a szimmetrikus mintázatok összemosódhatnak, mert kevesebb stabil jellegzetességet (feature-pontot) talál.

- Takart vagy torz részletek: Szemüveg, haj, árnyék, rossz megvilágítás, alacsony felbontás – mind rontja a pontosságot.

| Eredmény: Aránytalanul romlik az azonosítás pontossága, és nő a téves azonosítás esélye – különösen azoknál az arctípusoknál, ahol a tréningadatok alulreprezentáltak voltak. |

| Összefoglalva Az arcfelismerés esete jól mutatja, hogy az AI bias NEM csak emberi hiba (rossz tréningadat), hanem a feladat velejáró technikai nehézsége is közrejátszik. A két tényező kombinációja vezet a katasztrofálisan rossz eredményekhez bizonyos demográfiai csoportoknál. |

Problémák és kérdések

A bemutatott esetek jól mutatják, hogy az AI Act fontos mérföldkő a mesterséges intelligencia kockázatainak kezelésében – ugyanakkor a végrehajtási lánc érettsége és gyakorlati működése, különösen az ellenőrzés és a megfelelőség területén, további kérdéseket vet fel a tényleges hatékonyság és a valós kockázatcsökkentés tekintetében.

- A szabályozás magán viseli az EU-s szabályozások gyakori hibáját, mely inkább a végpontokat terheli, mert ott könnyebb jogot érvényesíteni. (A kockázatot a felhasználó szintjén állapítja meg.)

- A szabály megvan, de a végrehajtás sok bizonytalan elemet tartalmaz – ez sok esetben irreálisan magas plusz költséget terhel a szervezetekre (dokumentáció, audit, megfelelési adminisztráció), miközben a tényleges kockázat nem feltétlenül csökken.

- Az AI Act és a hasonló szabályozások a bias kérdést technikai problémaként kezelik. Holott a tréningadatokat, a címkézést, a betanítást és a célok megadását emberek végzik – erre a problémára a szabályozás nem kínál alternatívát.

- Ez pedig az ellenőrzés és a besorolás szintjén is hibákat és ellentmondásokat generál:

- Ki kalibrálja az AI-t?

- Ki fogja eldönteni, hogy egy AI mire alkalmas és milyen kockázatot képvisel? A fejlesztők, a jogászok és az etikai szakértők más-más szempontrendszerrel dolgoznak. A magáncégek profitorientáltak, az adatmérnökök elfogultak lehetnek saját adataik iránt.

- Ki ellenőrzi a rendszereket? Kormányzati szinten az ellenőrzés általában lassú és bürokratikus és nem feltétlenül rendelkeznek a megfelelő szakértelemmel. Független auditorok: ki fizeti őket? Ha maga a fejlesztő cég, az összeférhetetlen és visszaélésre adhat okot. Nyílt forráskód esetén üzleti titok sérülhet, enélkül viszont az ellenőrzés csak részleges. Civil szervezetek: az összes korábbi probléma együtt. Független testületek: ki tudja garantálni, hogy ezek objektív, elfogulatlan és szakmailag kompetens tagokból fognak állni?

- Hogyan oldható meg az átláthatóság anélkül, hogy üzleti titkot sértsen?

- Ki finanszírozza ezeket a vizsgálatokat és ellenőrzéseket és milyen forrásból?

- És: az AI iparág annyira gyerekcipőben jár, hogy azoknak a szakembereknek a száma, akik értik és átlátják az AI technikai működését és rendelkeznek jogi és etikai kompetenciával is, elenyésző. Kitermelésük évekbe telik.

- A költség-haszon elemzés megkérdőjelezi az AI Act üzleti realitását – különösen a KKV szektorban.

| Következtetés Az objektív AI egyelőre mítosz. Az AI olyan, amilyennek programozták – ez pedig a fejlesztőkön, adatmérnökökön és a megrendelőkön (cégvezetőkön) múlik. Egyik csoport sem független, mindenki piaci pozíció, siker és nyereség orientált. Ebben a környezetben az AI Act inkább compliance-ipart építő, mint valódi kockázatcsökkentő rendszer marad – legalábbis jelenlegi formájában. A végrehajtási mechanizmusok hiányosságai, a drága megfelelési követelmények és az ellenőrzési láncok tisztázatlansága miatt a szabályozás túlzott adminisztratív terhet ró a szervezetekre (méretüktől és iparági besorolásuktól függetlenül), anélkül, hogy a tényleges kockázatokat arányosan csökkentené. Ugyanakkor ez nem jelenti azt, hogy a szabályozás felesleges lenne. Az AI Act fontos első lépés egy olyan technológia kezelésére, amely alapjaiban változtatja meg a gazdaságot és a társadalmat. A kérdés nem az, hogy kell-e szabályozni, hanem hogy a szabályozás képes lesz-e alkalmazkodni a valós kihívásokhoz. |

Mulasztás és büntetési tételek

| Kategória | Határidő (büntethető innentől) | Büntetési tétel a szabályok megsértése esetén |

| Tiltott AI | 2025. február 2. | €35M VAGY a globális forgalom 7%-a |

| GPAI szabályok | 2025. augusztus 2. | €15M VAGY a globális forgalom 3%-a |

| Magas kockázat | 2026. augusztus 2. | €15M VAGY a globális forgalom 3%-a |

| Minden más | 2026. augusztus 2. | €7,5M VAGY a globális forgalom 1,5%-a |

| Mindig a MAGASABB összeg érvényes! | ||

A büntetési tételek a határidők lejártával elvben azonnal alkalmazhatók. A gyakorlat azonban (a GDPR bevezetéséhez hasonlóan) valószínűleg fokozatos végrehajtást fog hozni: először a nagyobb szervezetek és a magas kockázatú, egyértelműbb jogsértések kerülnek célkeresztbe, míg a KKV szektor számára várhatóan türelmi időszak érvényesül.

Ennek oka, hogy a végrehajtás minden EU tagállam saját felügyeleti hatóságának hatáskörébe tartozik – Magyarország pedig még nem jelölte ki teljesen a felügyeleti és végrehajtó hatóságot. Ez azonban nem jelenti azt, hogy a megfelelés halasztható: panasz alapján bármikor vizsgálat indulhat.

Gyakorlati példák – Magyar kontextus

A szabályozás könnyebb érthetősége kedvéért álljon itt néhány, magyar viszonylatban releváns gyakorlati példa előzetes költségbecsléssel.

| Szcenárió 1 – 50 fős cég: HR AI a CV-szűréshez Besorolás: Magas kockázat Kötelező: Kockázatértékelés, dokumentáció, emberi felügyelet 1. Kockázatértékelés (van-e bias az AI-ban?) 2. Emberi felügyelet és döntés (HR dönt, nem AI) 3. Dokumentáció (hogyan működik az AI, milyen adatokon tanult) 4. Átláthatóság (a jelöltek kérhetik a magyarázatot az elutasításhoz) Várható költség: ▸ Compliance: 2–5M Ft (audit, dokumentáció, jogi tanácsadás) ▸ Évente: fenntartás, frissítés Ez egy 50 fős cég esetében irreálisan magas költség – a kockázati besorolás járulékos terhei miatt az AI kiegészítő használata nem releváns opció, mivel a munkabér-költségek nem csökkennek, ellenben a bürokratikus terhek aránytalanul megnőnek. Ugyanez egy 500 fős cégnél, nagy fluktuációval és terjeszkedési időszakban már sokkal reálisabb beruházás. |

| Szcenárió 2 – E-kereskedelmi cég: AI chatbot az ügyfélszolgálaton Besorolás: Korlátozott kockázat Kötelező: Jelezni kell, hogy az ügyfél chatbottal kommunikál 1. "Egy AI chatbottal beszélgetsz" tájékoztató 2. "Emberrel szeretnék beszélni" opció biztosítása Várható költség: ▸ Alacsony – kb. 1–2 napos fejlesztői idő A bürokratikus költségek nem növelik jelentősen a fejlesztés erőforrásigényét – a bevezetés racionális és indokolt. |

| Szcenárió 3 – Marketing ügynökség: AI képgenerálás social mediához Besorolás: Korlátozott kockázat Kötelező: Jelezni kell, hogy a kép AI által generált 1. Tájékoztatás: "Ez egy AI által generált kép" 2. Vízjelezés vagy szignózás (nem kötelező, de ajánlott) Várható költség: ▸ Gyakorlatilag nulla – csak workflow módosítás szükséges, automatizálható |

| Szcenárió 4 – Pénzügyi cég: AI hitelminősítés Besorolás: Magas kockázat Kötelező: Szigorú audit, dokumentáció, emberi felügyelet 1. Kockázatértékelés (bias elleni védelem) 2. Emberi felügyelet és döntés (a hitelelbíráló dönt, nem AI) 3. Dokumentáció (hogyan működik az AI, milyen adatokon tanult) 4. Átláthatóság (ügyfél kérhet magyarázatot az elutasításhoz) 5. Megfelelőségi értékelés (Conformity assessment) – független audit Várható költség: ▸ Compliance: 10–20M Ft (audit, dokumentáció, jogi tanácsadás) ▸ Évente: audit, frissítés Pénzintézeti vagy pénzügyi használat esetén az AI előnyei és kockázatcsökkentő hatása akkora hasznot generálhat, ami indokolttá teszi az AI Act megfelelés plusz költségeinek finanszírozását. |

Összefoglalva

Az AI nagy segítség a mindennapi munkában: rengeteg időt és forrást takarít meg, így használata szabályozott keretek között minden szervezet számára előnyös megoldás lehet.

Az AI Act egy indokolt és időszerű szabályozási kísérlet, amely lehetővé teheti a mesterséges intelligenciák etikus és átlátható használatát – ha a gyakorlatból származó tapasztalatok alapján a jogalkotó képes lesz finomítani a végrehajtási mechanizmusokat.

A szabályozás hatékonysága attól függ, képes-e kinőni jelenlegi gyerekágyi betegségeit: a végrehajtási útvonalak és láncok pontos kijelölése, az arányosabb költségmegosztás és a független, szakmailag kompetens ellenőrzési rendszer kialakítása nélkül a szabályozás csak papíron fog megfelelni eredeti céljának.

| A szabályozás magyar nyelven: Az Európai Parlament és a Tanács (EU) 2024/1689 rendelete (2024. június 13.) a mesterséges intelligenciára vonatkozó harmonizált szabályok megállapításáról |

| TRANSPARENCY DISCLOSURE – AI Act compliance Szerző és szerkesztő, infografika: Szabó Roxána © 5N Kft AI-támogatás: ▸ Háttérinformációk, fogalommagyarázatok: Claude AI (Anthropic), ChatGPT (OpenAI) ▸ Tartalmi és stilisztikai ellenőrzés: Claude AI (Anthropic) ▸ Képgenerálás: a képek egy része AI segítségével, szerkesztéssel készült. ChatGPT (OpenAI) |